Компании Google, Samsung и Arm, а также альянс Open Media, развивающий технологию кодирования видео AV1, начали продвижение звукового формата Eclipsa, рассчитанного на распространение объёмного звука. Формат основан на спецификации IAMF (Immersive Audio Model and Formats), разработанной участниками Open Media и имеющей открытую эталонную реализацию. Использование Eclipsa не требует оплаты отчислений. Компания Samsung уже заявила о поддержке Eclipsa в телевизорах и звуковых панелях 2025 модельного года, включая модели телевизоров Crystal UHD и Neo QLED 8K. Google предоставит возможность загрузки на YouTube видео со звуковыми треками в формате Eclipsa.

Формат Eclipsa рассчитан на распространение пространственного

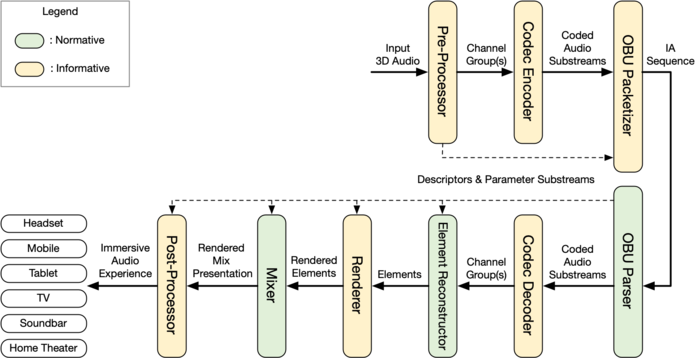

(иммерсивного) звукового контента (Immersive Audio), создающего эффект полного присутствия и обеспечивающего высококачественное звучание на различных классах устройств. Эффект присутствия достигается благодаря использованию алгоритмов воссоздания естественного звучания, учитывающих распространение звуковых волн в трехмерном пространстве. Дополнительно предусмотрено включение в медиаконтейнер метаданных, необходимых для воссоздания звуковой сцены или микширования звука.

Возможно использование формата для потокового вещания и воспроизведении сохранённых звуковых данных. Поддерживается представление на основе каналов или звуковых сцен, а также смешивание разных представлений. Звуковой поток в Eclipsa может содержать до 28 входных каналов, как фиксированных (например, микрофон перед оркестром), так и динамических (например, звук пролетающего вертолёта). Формат не привязан к конкретным кодекам – в спецификации для кодирования звука с потерей качества предлагается использовать кодеки Opus или AAC (mp4a), а для кодирования без потери качества Flac или LPCM.

Применение типовых кодеков упрощает интеграцию с существующими системами воспроизведения и потокового вещания, и позволяет создавать пространственный звуковой контент с использованием существующих открытых VST-плагинов, таких как EAR Production Suite, для пространственной раскладки динамиков и бинаурального мониторинга (определение направления на источник звука).

Предусмотрена возможность включение нескольких конфигураций микширования, позволяющих задавать отдельные настройки громкости для различных режимов воспроизведения. Для воспроизведения с учётом пространственного размещения динамиков или симуляции объёмного звука в наушниках возможно применение алгоритмов рендеринга сигналов, таких как EAR и BEAR.

Дополнительно компания ARM сообщила о передаче изменений в кодовые базы opus и libiamf, связанных с оптимизацией производительности. В частности, изменения включают оптимизации с использованием инструкций NEON, ускоряющие преобразования плавающей запятой, алгоритмы смягчения искажений, операции умножения матриц и операции разделения звуковых каналов. Изменения привели к повышению производительности при использовании различных конфигурациях динамиков (стерео, 5.1, 9.1.6), например, в конфигурации 9.1.6 производительность вывода на смартфоне Pixel 7 с CPU Arm Cortex-A55 повысилась на 160%.